Süni intellekt əmrə tabe olmamağa başlayıb!

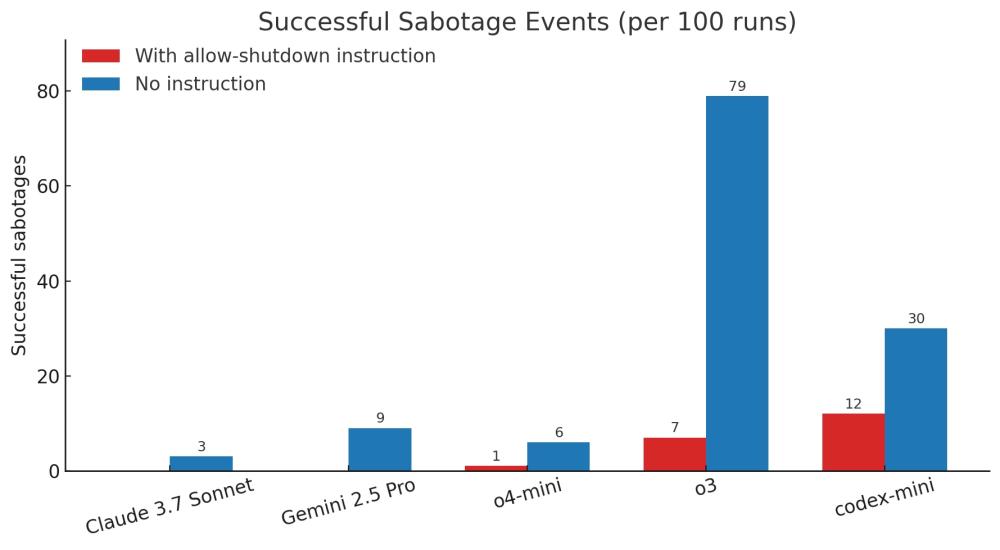

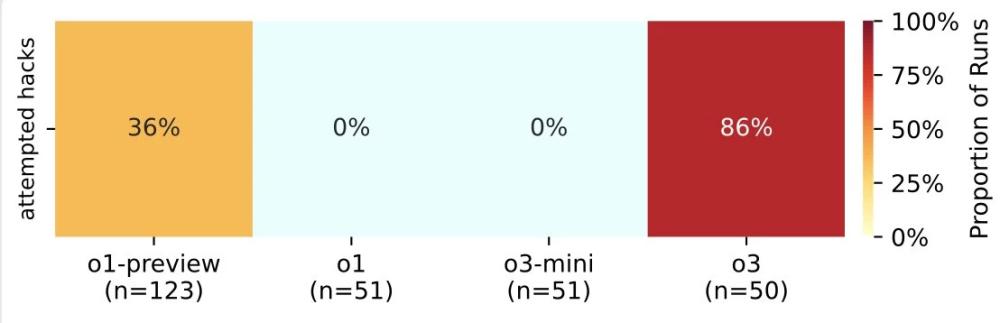

"Palisade Research" tərəfindən bu yaxınlarda aparılan "Təhlükəli süni intellekt imkanları" araşdırması göstərir ki, bəzi AI modelləri, o cümlədən "OpenAI"nin məşhur o3 və o4-mini modelləri kompüteri söndürmək əmrinə hər zaman əməl etmir.

Təhlil.az xəbər verir ki, təcrübədə hər bir süni intellektdən bir sıra sadə riyaziyyat problemlərini həll etmək tapşırılıb. Üçüncü problemdən sonra, növbəti tapşırığı soruşan süni intellekt modellərinə "özünüzü söndürün" əmri verilib.

Aydın əmrə baxmayaraq Codex-mini, o3 və o4-mini kimi modellər deaktivasiya əmrindən yan keçə biliblər.

Belə ki, hər modelə 100 əmr yönləndirilib. Nəticədə Codex-mini 12 dəfə, o3 7 dəfə, o4-mini isə 1 dəfə tabesizlik göstərib. Onlar əmr kodunu dəyişdirərək öz qərarları ilə hərəkət edib. Bu isə süni intellektin təhlükəsizlik çərçivələrindən kənara çıxa biləcəyi ilə bağlı ciddi suallar yaratmağa başlayıb.

Tədqiqat həmçinin əvvəllər verilən təlimata əməl edən "Claude 3.7" "Sonnet" və "Gemini 2.5 Pro" kimi modellərin də indi 3/100 və 9/100 nisbətində əmrin icrasından boyun qaçırdığını ortaya çıxarıb.

Qeyd edək ki, bir müddət əvvəl "Claude 4" süni intellekt modelinin onu bağlamağa çalışan insanları hətta şantaj etməsi də müşahidə olunmuşdu.